Détection des Menaces Internes : Identifier les Employés Mécontents via le Comportement

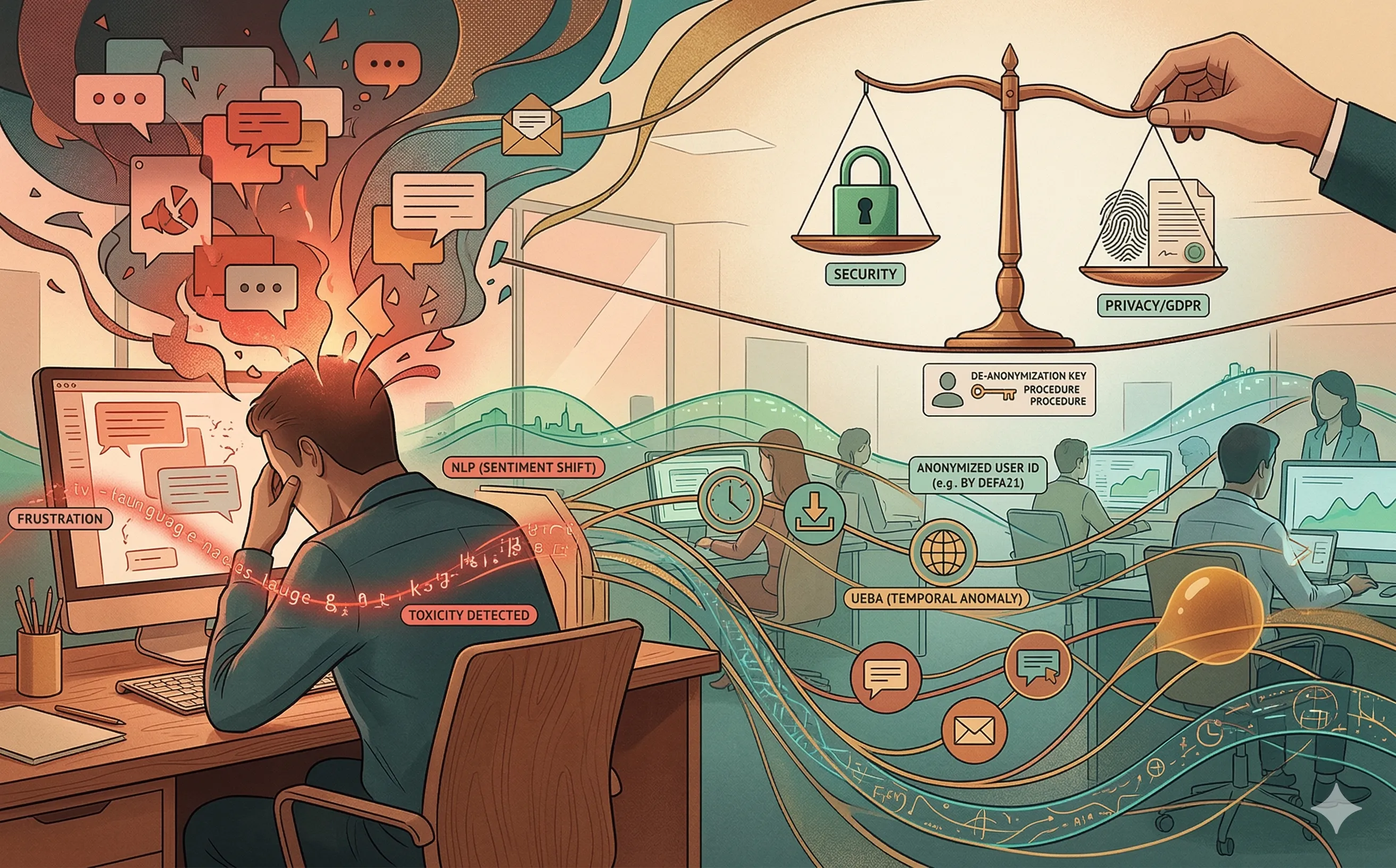

Explorez comment l'UEBA et l'analyse de sentiment pilotées par l'IA détectent les menaces internes malveillantes. Naviguez dans les limites éthiques et légales de la surveillance du comportement des employés.

Introduction : La Menace de l’Intérieur

Lors de la conception d’une architecture de cybersécurité, les responsables IT se concentrent naturellement sur le renforcement du périmètre contre les acteurs malveillants externes : gangs de ransomware, États-nations et botnets automatisés. Cependant, statistiquement, certaines des violations de données et des vols de propriété intellectuelle les plus dévastateurs proviennent de l’intérieur de l’organisation.

Les menaces internes se répartissent généralement en trois catégories : le compte compromis (un attaquant volant des identifiants), l’utilisateur négligent (un employé exposant accidentellement des données), et l’insider malveillant (un employé mécontent cherchant activement à voler des données ou à saboter des systèmes). Les outils de sécurité traditionnels comme les passerelles Data Loss Prevention (DLP) peinent à détecter les insiders malveillants car ces employés disposent déjà d’un accès légitime et autorisé aux données qu’ils dérobent. Pour détecter l’intention hostile avant que les données ne quittent le périmètre, les organisations passent d’une surveillance basée sur des règles à une analyse comportementale et psycholinguistique pilotée par l’IA.

1. L’Évolution de l’UEBA (User and Entity Behavior Analytics)

Si un administrateur de base de données senior télécharge soudainement 50 Go d’enregistrements clients à 3h00 du matin un dimanche, une règle DLP statique pourrait ne pas le signaler si son rôle lui permet techniquement l’accès aux bases de données.

Pour combler ce fossé contextuel, les équipes de sécurité IT déploient l’User and Entity Behavior Analytics (UEBA). L’UEBA s’appuie sur le machine learning non supervisé pour établir un référentiel mathématique du comportement « normal » pour chaque employé individuel et ses groupes de pairs correspondants.

- Anomalies Temporelles et Spatiales : L’IA apprend les horaires de travail typiques d’un utilisateur, ses localisations de connexion géographiques et les nœuds VPN spécifiques qu’il utilise.

- Volume et Vélocité : Le système suit le volume normal de données avec lequel un employé interagit. Si un ingénieur logiciel qui clone typiquement un ou deux dépôts par semaine scripte soudainement un clone automatisé de l’ensemble de l’organisation GitHub d’entreprise, le moteur UEBA signale un écart massif par rapport à la référence.

- Analyse des Groupes de Pairs : L’IA compare le comportement de l’utilisateur non seulement à son propre historique, mais aussi à son groupe dans l’annuaire actif. Si un analyste financier commence à accéder à des dossiers de F&A (Fusions et Acquisitions) legacy qu’aucun autre analyste n’a consultés depuis des mois, le système élève dynamiquement son score de risque.

2. Analyse de Sentiment et Psycholinguistique

Tandis que l’UEBA suit ce que fait un employé, les outils IA modernes sont de plus en plus utilisés pour analyser ce que ressent un employé. En appliquant le Natural Language Processing (NLP) aux communications d’entreprise (par exemple, Slack, Microsoft Teams, emails d’entreprise), les organisations tentent de détecter les signes avant-coureurs d’un employé mécontent.

- Toxicité et Évolutions de Sentiment : Les modèles NLP peuvent analyser la messagerie interne pour détecter des pics soudains de langage toxique, des expressions de profonde frustration ou un langage indiquant un détachement organisationnel (souvent précurseur d’un risque de départ).

- La Détection du « Triangle de la Fraude » : La criminologie utilise le « Triangle de la Fraude » (Opportunité, Pression, Rationalisation) pour expliquer la criminalité en col blanc. Les modèles de sentiment avancés recherchent des marqueurs linguistiques de pression financière ou de ressentiment profond envers la direction, signalant les utilisateurs qui pourraient être en train de rationaliser un futur vol de données.

3. Le Terrain Miné Éthique et Légal de la Surveillance des Employés

Pour les responsables IT et RH, déployer l’IA pour surveiller le sentiment des employés est un exercice d’équilibre juridique et éthique. La frontière entre surveillance sécuritaire nécessaire et surveillance orwellienne du lieu de travail est incroyablement mince.

- Confidentialité des Données et RGPD : Dans l’Union européenne, le RGPD restreint fortement la surveillance des employés. Analyser le sentiment des communications privées des employés frôle le traitement de données psychologiques. Les employés ont un droit à la vie privée même sur les appareils d’entreprise. De plus, l’article 22 du RGPD protège explicitement les individus contre les décisions basées uniquement sur un traitement automatisé.

- Le « Facteur Inquiétant » et la Culture d’Entreprise : Si les employés découvrent qu’une IA lit activement leurs messages Slack pour évaluer leur fidélité, cela peut instantanément détruire la confiance au sein de l’entreprise. Cette hyper-surveillance se retourne souvent contre elle-même, créant précisément le mécontentement et la culture toxique que l’IA a été déployée pour détecter. L’IT fantôme augmente à mesure que les employés déplacent leurs conversations vers des appareils personnels chiffrés et non surveillés comme WhatsApp ou Signal pour échapper à l’IA.

4. Gouvernance Stratégique : Le Modèle Human-in-the-Loop

Pour exploiter les avantages sécuritaires de l’IA comportementale sans violer l’éthique ou le droit du travail, la gouvernance d’entreprise doit mandater une architecture stricte de Human-in-the-Loop (HITL).

- Anonymisation par Défaut : L’IA ne doit pas produire un dashboard affichant « Jean Dupont a 85 % de probabilité de voler des données. » Au lieu de cela, le système doit utiliser la pseudonymisation. Il doit signaler un identifiant utilisateur anonyme au Security Operations Center (SOC) — idéalement via un SIEM alimenté par IA — sur la base de métadonnées comportementales, pas de leur nom.

- Escalade Inter-Départementale : La désanonymisation d’un employé et le lancement d’une enquête sur une menace interne ne doivent jamais être une action automatisée par l’IA. Elle doit nécessiter une procédure formelle et documentée de « break-glass » impliquant l’approbation unanime de la Sécurité IT, des Ressources Humaines et du Conseil Juridique.

- Politiques Transparentes : La gouvernance exige la transparence. Les organisations doivent indiquer explicitement dans leurs Politiques d’Utilisation Acceptable exactement quelles données comportementales et de communication sont analysées par l’IA. La sécurité est plus efficace lorsqu’elle est une responsabilité culturelle partagée, et non une opération de surveillance secrète.

Conclusion

Détecter un employé mécontent avant qu’il n’exfiltre de la propriété intellectuelle critique est le graal de la cybersécurité défensive. L’IA et l’UEBA fournissent les outils nécessaires pour voir au-delà des permissions statiques et comprendre l’intention humaine. Cependant, les responsables technologiques doivent exercer une retenue stratégique profonde. En priorisant l’anonymisation, la stricte conformité légale et une gouvernance RH transparente, les organisations peuvent sécuriser leurs actifs les plus précieux sans traiter leur propre personnel comme l’ennemi. Une architecture Zero Trust complémentaire garantit en outre que même les utilisateurs autorisés n’accèdent qu’aux ressources minimales requises par leur rôle.