Ethical Hacking avec l'IA : Red Teaming avec des Outils Automatisés

Explorez comment l'IA révolutionne l'ethical hacking et le red teaming. Découvrez les avantages stratégiques et les exigences de gouvernance liés à l'émulation adversariale automatisée.

Introduction : L’Évolution du Test d’Intrusion

Pendant des décennies, la méthode standard pour valider la posture de sécurité d’une organisation a été le test d’intrusion annuel. Une équipe d’ethical hackers est engagée pour sonder manuellement le périmètre, enchaîner des exploits et produire un rapport PDF détaillant les vulnérabilités. Cependant, à l’ère du développement Agile, des pipelines CI/CD et des microservices cloud-native, une infrastructure évolue quotidiennement. Une évaluation ponctuelle est souvent obsolète au moment où le rapport est livré.

Pour s’aligner sur la vitesse du développement moderne et la sophistication des acteurs malveillants, les responsables IT transforment leur approche de la validation de la sécurité. Le secteur passe des tests d’intrusion manuels et périodiques vers un Red Teaming continu et piloté par l’IA. En armant des Large Language Models (LLMs) et des agents autonomes pour l’ethical hacking, les organisations peuvent tester en permanence leurs défenses, imitant à grande échelle les tactiques, techniques et procédures (TTPs) exactes des menaces persistantes avancées (APTs).

1. L’Automatisation de la Reconnaissance et de la Weaponisation

La Cyber Kill Chain traditionnelle commence par la reconnaissance — une phase fastidieuse où les hackers fouillent les archives publiques, scannent les ports et cartographient la surface d’attaque de la cible. L’IA accélère considérablement cette phase, transformant des jours d’énumération manuelle en quelques minutes d’analyse automatisée.

- OSINT Algorithmique : Les ethical hackers déploient désormais des agents IA pour scraper de manière autonome des dépôts GitHub, des forums du dark web et des profils LinkedIn. Ces modèles utilisent le Natural Language Processing (NLP) pour analyser des données non structurées, identifiant des identifiants compromis, des endpoints API exposés et des hiérarchies organisationnelles pouvant être ciblées pour du spear-phishing.

- Cartographie Intelligente des Vulnérabilités : Au lieu de s’appuyer sur des scanners de vulnérabilités rigides basés sur des signatures (comme Nessus ou Qualys) qui génèrent des milliers de faux positifs, les outils de red team pilotés par l’IA ingèrent les données de scan et les corrèlent avec le renseignement sur les menaces externes. L’IA identifie quelles vulnérabilités spécifiques sont activement exploitées dans la nature et trace les chemins d’attaque les plus probables vers le réseau.

2. Génération Dynamique d’Exploits et Évasion

Une fois une vulnérabilité trouvée, l’attaquant doit l’exploiter. Historiquement, les ethical hackers s’appuyaient sur des bases de données d’exploits statiques (comme Exploit-DB ou Metasploit). Si un système cible disposait d’une version légèrement différente du système d’exploitation ou d’un Web Application Firewall (WAF) personnalisé, l’exploit statique échouait, obligeant le hacker à réécrire manuellement le payload.

L’IA générative modifie fondamentalement cette dynamique.

- Mutation de Payload : Les red teams utilisent des LLMs pour générer et muter automatiquement du code d’exploit à la volée. Si un système défensif bloque un payload d’injection SQL initial, l’IA peut instantanément générer cinquante variations obfusquées — utilisant différents encodages, polyglots et structures syntaxiques — jusqu’à ce que l’une d’elles contourne avec succès le WAF.

- Contournement de l’EDR : L’IA est également utilisée pour automatiser l’évasion des systèmes Endpoint Detection and Response (EDR). Des modèles de machine learning analysent les signatures comportementales que les EDR recherchent et réécrivent automatiquement les wrappers de malware pour randomiser l’allocation mémoire et les appels API, garantissant que le payload du red team reste totalement indétecté pendant l’exercice.

3. L’Essor du CART (Continuous Automated Red Teaming)

L’objectif stratégique ultime de l’intégration de l’IA dans l’ethical hacking est la réalisation du Continuous Automated Red Teaming (CART).

Les plateformes CART utilisent des agents IA autonomes qui opèrent 24h/24 et 7j/7 au sein du réseau d’entreprise.

- Émulation Adversariale : Ces agents sont programmés pour émuler en toute sécurité le comportement de groupes de ransomware connus ou d’acteurs étatiques. Ils tentent en permanence de se déplacer latéralement, d’escalader les privilèges et d’exfiltrer des données fictives.

- Validation de la Blue Team : Pour le Chief Information Security Officer (CISO), le CART fournit une preuve empirique de l’état de préparation défensive de l’organisation. Si un ingénieur IT configure accidentellement mal un cluster Kubernetes un mardi, l’agent CART découvrira et exploitera de manière autonome cette faille le mercredi, déclenchant une alerte vers le Security Operations Center (SOC) avant qu’un vrai attaquant ne puisse la trouver.

4. Gouvernance et Risques du Hacking Autonome

Bien que les avantages stratégiques du red teaming piloté par l’IA soient immenses, le déploiement d’agents de hacking autonomes introduit des risques opérationnels sévères. Par définition, vous libérez un morceau de malware auto-pensant dans votre propre environnement d’entreprise.

Pour les responsables technologiques, une gouvernance stricte et des « règles d’engagement » sont obligatoires :

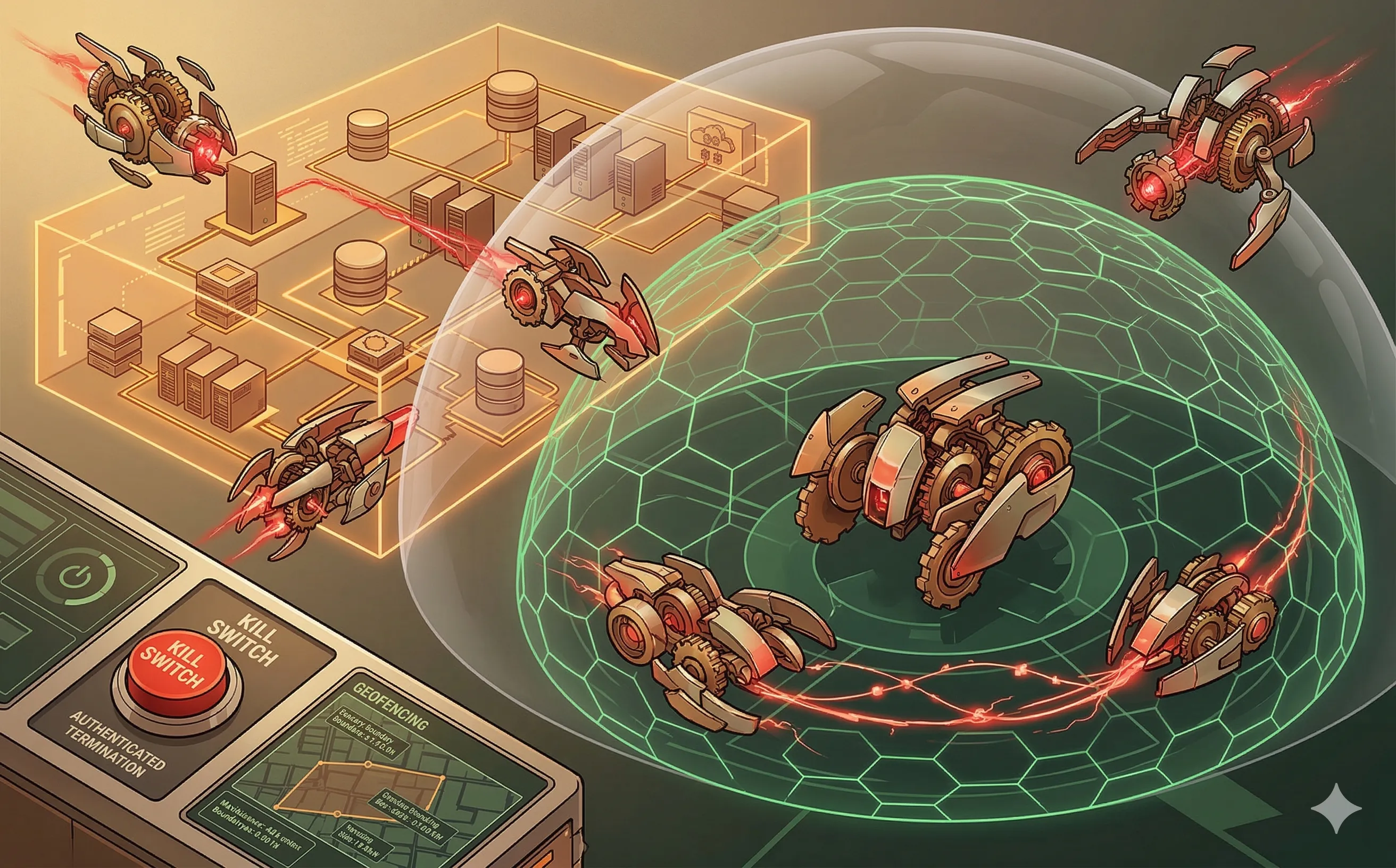

- Contrôle du Périmètre et des Limites : Les agents autonomes doivent être strictement délimités géographiquement. Un agent IA mal configuré pourrait facilement sortir de l’environnement de test désigné et lancer accidentellement une attaque par déni de service contre une base de données de production critique, causant une interruption d’activité majeure.

- Le « Kill Switch » : Toute plateforme de red teaming piloté par l’IA doit disposer d’un « kill switch » déterministe et fortement authentifié. Si l’agent autonome commence à agir de manière imprévisible ou à consommer trop de ressources système, l’équipe de sécurité doit pouvoir terminer instantanément tous ses processus actifs et connexions réseau.

- Garde-fous Éthiques : Lors de l’utilisation de LLMs pour générer des campagnes de spear-phishing à des fins de formation des employés, les organisations doivent fixer des limites éthiques strictes. L’IA doit être limitée dans l’utilisation de déclencheurs émotionnels hautement manipulateurs (comme simuler une urgence familiale ou un avis de licenciement) susceptibles de causer une détresse psychologique réelle aux employés.

Conclusion

L’asymétrie de la cybersécurité — où le défenseur doit avoir raison 100 % du temps, tandis que l’attaquant n’a besoin d’avoir raison qu’une seule fois — est lentement rééquilibrée par l’IA. En adoptant le Continuous Automated Red Teaming et l’ethical hacking piloté par l’IA, les responsables IT peuvent s’éloigner des checklists de conformité et adopter un véritable état d’esprit adversarial. Cependant, exploiter cette puissance exige une gouvernance rigoureuse pour s’assurer que les outils autonomes conçus pour protéger le réseau ne deviennent pas ceux qui le font tomber.