Gestion des secrets : empêcher l'IA de hardcoder des clés

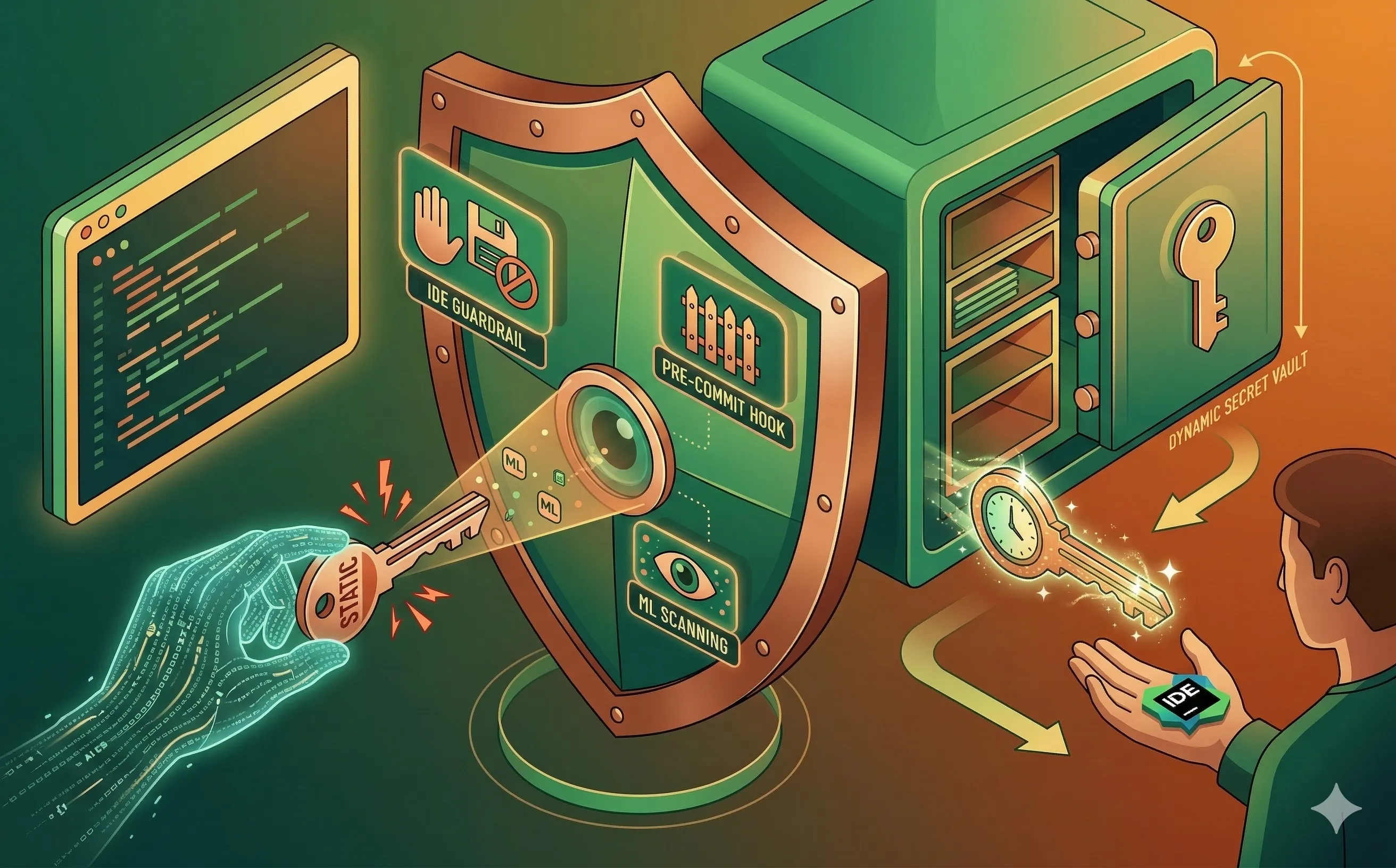

Apprenez à empêcher les assistants de code IA de hardcoder des secrets. Explorez le scan de secrets par ML, les pre-commit hooks et l'intégration dynamique avec un vault.

Introduction : La voie de la moindre résistance

Hardcoder des secrets — clés d’API, mots de passe de bases de données (de plus en plus vulnérables au crackage de mots de passe par IA) et certificats cryptographiques — directement dans le code source est l’une des pratiques les plus anciennes et les plus dangereuses du développement logiciel. Malgré des années de formations en AppSec, c’est toujours l’une des principales causes de violations de données massives.

Avec l’introduction des assistants de code IA, ce problème s’est accéléré. Les Large Language Models (LLMs) sont entraînés pour fournir la solution la plus rapide et la plus fonctionnelle à la requête d’un développeur. Souvent, la voie de la moindre résistance pour faire fonctionner un script est de déclarer une variable globale avec une clé d’API en clair. Si les développeurs ne mettent pas en œuvre activement des architectures robustes de gestion des secrets, les assistants IA les aideront volontiers à committer les clés numériques du royaume directement dans un dépôt GitHub public.

1. Comment l’IA encourage les secrets hardcodés

Pour comprendre comment empêcher l’IA de faire fuiter des secrets, il faut d’abord comprendre pourquoi cela se produit. Les assistants IA apprennent à partir de motifs dans leurs données d’entraînement. Malheureusement, les dépôts open source sont truffés de tutoriels, de guides de démarrage rapide et de preuves de concept qui présentent abondamment des identifiants placeholder hardcodés.

- Le piège du placeholder : Lorsqu’on lui demande d’écrire une chaîne de connexion à une base de données, une IA peut générer

const dbPassword = "YOUR_PASSWORD_HERE";. Un développeur, pressé de tester le code, remplace la chaîne par le vrai mot de passe de production, avec la ferme intention de « le corriger plus tard ». Le code fonctionne, il est distrait, et le secret est commité. - Clés de test régurgitées : Parfois, l’IA génère du code en utilisant des clés d’API réelles et actives qu’elle a ingérées lors de l’entraînement (un phénomène connu sous le nom de mémorisation des données). Si un développeur utilise inconsciemment cette clé mémorisée, son application peut fonctionner temporairement mais est liée à une infrastructure compromise.

- Manque de conscience architecturale : Un assistant de code IA vivant dans votre IDE ne connaît pas intrinsèquement l’implémentation de HashiCorp Vault ou d’AWS Secrets Manager de votre entreprise, à moins que vous ne lui demandiez explicitement d’utiliser ces services.

2. Scan de secrets enrichi par ML

La défense traditionnelle contre les secrets hardcodés est un scanner basé sur des expressions régulières qui s’exécute dans le pipeline CI/CD. Cependant, les règles regex standard génèrent d’énormes quantités de faux positifs, signalant des chaînes de test aléatoires, des hash de commit ou des variables de configuration bénignes.

Le DevSecOps moderne s’appuie sur le scan de secrets enrichi par Machine Learning pour résoudre ce problème.

- Analyse d’entropie et de contexte : Au lieu de simplement chercher la chaîne « password », les modèles ML analysent l’entropie mathématique (l’aléatoire) de la chaîne et le contexte syntaxique environnant — tout comme les outils SAST et DAST enrichis par le ML utilisent le contexte pour réduire les faux positifs. Ils comprennent la différence entre une clé d’accès AWS de 64 caractères à haute entropie et un placeholder d’image encodé en base64 de longueur similaire mais bénin.

- Validation active : Les scanners de secrets les plus avancés ne se contentent pas de signaler la chaîne ; ils envoient de manière autonome une requête ping à l’API du fournisseur de service correspondant (par exemple, Stripe, Slack ou GitHub) en arrière-plan pour vérifier si le token découvert est réellement actif et valide avant d’alerter le développeur.

3. Shift Left : garde-fous dans l’IDE et pre-commit hooks

Trouver un secret dans un dépôt Git — même privé — est souvent trop tard. Une fois qu’un secret est dans l’historique des commits, il doit être considéré comme compromis et entièrement renouvelé, ce qui entraîne des interruptions opérationnelles. L’objectif est d’empêcher le secret de quitter l’ordinateur du développeur.

- Scanners intégrés à l’IDE : Les équipes de sécurité doivent déployer des plugins légers de scan de secrets directement dans l’IDE du développeur (VS Code, IntelliJ). Si GitHub Copilot génère un bloc de code contenant un token suspect, ou si le développeur en colle un, l’IDE le surligne immédiatement en rouge, bloquant l’action de sauvegarde jusqu’à ce que le secret soit supprimé.

- Pre-commit hooks : L’ultime filet de sécurité est un pre-commit hook Git (comme Talisman ou

ggshieldde GitGuardian). Lorsque le développeur tapegit commit, le hook exécute un scan ML local sur les changements en attente. Si un secret est détecté, le commit est purement et simplement rejeté, forçant le développeur à refactoriser le code pour utiliser des variables d’environnement à la place.

4. Concevoir pour les secrets dynamiques

La méthode la plus efficace pour empêcher l’IA de hardcoder des secrets est de concevoir votre application de sorte que les secrets statiques ne soient pas nécessaires. Les équipes DevSecOps doivent guider les développeurs (et leurs assistants IA) vers l’utilisation de secrets dynamiques et de vaults.

- Prompt engineering pour les vaults : Les développeurs doivent être formés à inclure des instructions de gestion des secrets dans leurs prompts IA. Au lieu de demander « Écris un script Python pour se connecter au bucket AWS S3 », le prompt devrait être « Écris un script Python pour se connecter au bucket AWS S3, en récupérant dynamiquement les identifiants IAM temporaires depuis HashiCorp Vault ». Cette approche soutient également les exigences de souveraineté des données en maintenant les identifiants dans des environnements contrôlés.

- Tokens à courte durée de vie : En intégrant les applications avec des gestionnaires de secrets dynamiques, l’application demande un mot de passe de base de données généré à la volée qui expire dans 15 minutes. Même si un assistant IA hallucine ou fait fuiter ce token spécifique lors d’une session de débogage, le rayon de l’explosion est minimal car l’identifiant s’autodétruit presque immédiatement.

Conclusion

Les outils IA optimisent pour la vitesse, mais la sécurité requiert de la friction. Empêcher l’IA de hardcoder des clés nécessite une approche multicouche : former les développeurs au prompt engineering sécurisé, déployer des scanners pilotés par ML dans l’IDE pour détecter les erreurs en temps réel, et concevoir des systèmes reposant sur des identifiants dynamiques à courte durée de vie. En gérant correctement les secrets, vous vous assurez que votre assistant IA écrit du code prêt pour la production, et non le prochain payload d’un hacker.