L'EU AI Act : exigences de conformité pour les systèmes à haut risque

Comprenez l'impact de l'EU AI Act sur l'IT d'entreprise. Découvrez la classification des systèmes IA à haut risque et les exigences de conformité obligatoires avant la deadline de 2026.

Introduction : Le RGPD de l’intelligence artificielle

Bienvenue dans la quatrième et dernière série de notre veille technologique : Gouvernance, Éthique et Tendances futures. Au cours des neuf derniers mois, nous avons exploré les réalités tactiques de l’IA en cybersécurité — de la prompt injection offensive au machine learning défensif en passant par le DevSecOps. Cependant, la technologie n’existe pas dans le vide. Pour les responsables IT et les architectes, déployer de l’IA n’est plus seulement un défi technique ; c’est une responsabilité juridique et stratégique profonde.

Le changement réglementaire le plus significatif de notre industrie depuis le RGPD est désormais en cours : L’European Union Artificial Intelligence Act (EU AI Act). Entré officiellement en vigueur en août 2024, le texte prévoit un déploiement par phases. Si les interdictions concernant les systèmes à « risque inacceptable » sont déjà actives, la date limite la plus critique pour les équipes IT d’entreprise approche rapidement : le 2 août 2026. D’ici là, tous les systèmes IA « à haut risque » devront entièrement se conformer aux mandats stricts de gouvernance, de transparence et de cybersécurité.

1. L’approche basée sur le risque et la classification

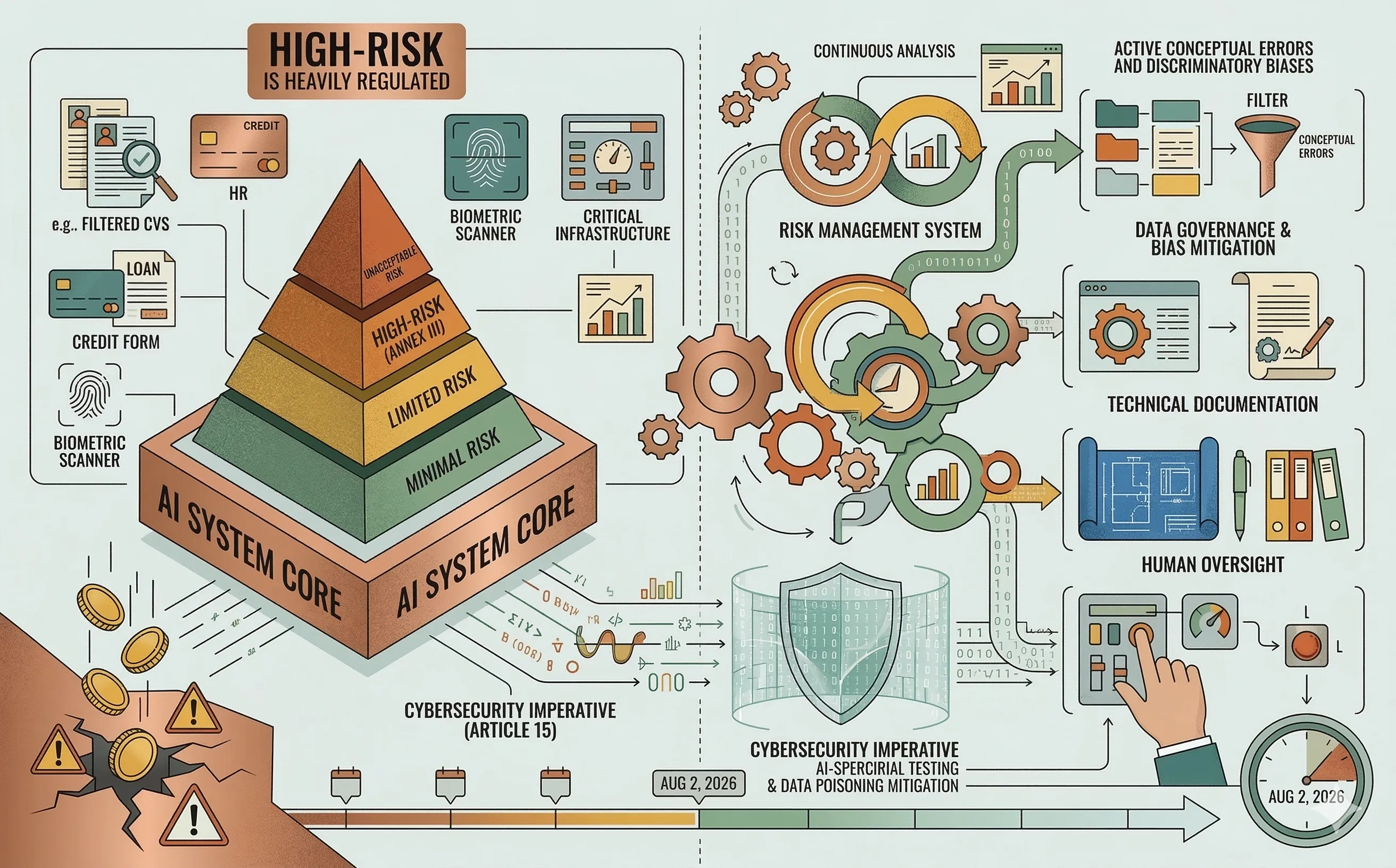

L’EU AI Act ne réglemente pas la technologie sous-jacente (comme les réseaux de neurones eux-mêmes) ; il réglemente le cas d’usage. Il divise les applications IA en une pyramide de risques à quatre niveaux.

Pour les organisations d’entreprise, la catégorie la plus cruciale à identifier est celle des systèmes à haut risque (Annexe III). Si votre organisation développe, déploie ou importe un système IA relevant de l’une des catégories suivantes, vous êtes fortement réglementé :

- Emploi et RH : IA utilisée pour le recrutement, le filtrage de CV, la surveillance de la productivité des employés ou la résiliation de contrats.

- Services privés et publics essentiels : IA utilisée pour le scoring de crédit (approbation de prêts) ou la détermination des primes d’assurance vie/santé.

- Biométrie : Systèmes d’identification et de catégorisation biométriques à distance.

- Infrastructures critiques : IA utilisée comme composant de sécurité dans la gestion des infrastructures numériques, de l’eau, du gaz ou de l’électricité.

- Éducation : IA utilisée pour évaluer les résultats d’apprentissage ou déterminer les admissions.

Note : Les systèmes IA intégrés comme composants de sécurité dans des produits physiques (comme les dispositifs médicaux ou les véhicules) relèvent de l’Annexe I et bénéficient d’un délai de conformité légèrement plus long jusqu’en août 2027.

2. Exigences de conformité obligatoires

Si votre système est classifié à haut risque, « aller vite et casser les choses » n’est plus légalement autorisé. Les fournisseurs et les déployeurs doivent mettre en place un cadre de conformité complet avant que le système puisse recevoir le marquage CE et entrer sur le marché européen.

- Systèmes de gestion des risques et de la qualité : Les organisations doivent établir un processus continu et itératif de gestion des risques tout au long du cycle de vie complet de l’IA. Il ne peut pas s’agir d’un audit ponctuel ; cela nécessite un Système de Management de la Qualité (SMQ) permanent pour documenter comment les risques sont identifiés et atténués.

- Gouvernance des données et atténuation des biais : L’Acte impose explicitement que les datasets utilisés pour l’entraînement, la validation et les tests soient pertinents, représentatifs et, dans la mesure du possible, exempts d’erreurs. Vous devez prouver que vous avez activement recherché et atténué les biais discriminatoires dans vos données d’entraînement.

- Documentation technique et archivage : Les déploiements en boîte noire sont illégaux pour les systèmes à haut risque. Les fournisseurs doivent maintenir une documentation technique exhaustive détaillant l’architecture, les capacités et les limitations du modèle. De plus, le système doit automatiquement journaliser les événements (traçabilité) afin que les autorités puissent enquêter sur les incidents si l’IA prend une décision préjudiciable.

- Supervision humaine (Human-in-the-Loop) : Les systèmes à haut risque doivent être conçus de manière à permettre à des personnes physiques de les superviser efficacement. Un humain doit pouvoir intervenir, contrecarrer la décision de l’IA ou actionner un « kill switch » si le système se comporte de manière inattendue.

3. L’impératif cybersécurité (Article 15)

Du point de vue de la cybersécurité, l’EU AI Act élève l’AppSec d’une bonne pratique à une obligation légale. L’Article 15 impose aux systèmes IA à haut risque d’atteindre des niveaux appropriés de précision, de robustesse et de cybersécurité.

Le texte cible explicitement les vecteurs de menace spécifiques à l’IA. Les organisations doivent prouver que leurs modèles à haut risque sont résilients face à :

- La data poisoning : Les tentatives d’acteurs malveillants de corrompre les données d’entraînement.

- Les exemples adversariaux : Des entrées conçues pour tromper le modèle et lui faire effectuer une fausse classification (par exemple, contourner la sécurité biométrique).

- Les défauts du modèle : Des incohérences ou des failles dans l’environnement d’exploitation.

Pour l’équipe de cybersécurité, cela signifie que le scan de vulnérabilités traditionnel n’est plus suffisant. Vous devez mettre en place un red team et des tests de robustesse adversariale spécifiques à l’IA pour certifier légalement le système. Pour approfondir la structuration de cette démarche au sein de votre organisation, consultez notre article sur la gouvernance de l’IA défensive.

4. Le coût de la non-conformité

Les sanctions financières conçues pour faire respecter l’EU AI Act sont sévères, dépassant même celles du RGPD.

- Systèmes interdits : Le déploiement d’un système IA à « risque inacceptable » (par exemple, le scoring social ou la manipulation cognitive) est passible d’amendes pouvant atteindre 35 millions d’euros ou 7 % du chiffre d’affaires annuel mondial total, le montant le plus élevé étant retenu.

- Non-conformité pour les systèmes à haut risque : Le non-respect des obligations strictes pour les systèmes à haut risque (par exemple, ignorer l’évaluation de conformité ou négliger la supervision humaine) peut entraîner des amendes pouvant atteindre 15 millions d’euros ou 3 % du chiffre d’affaires annuel mondial total.

- Informations trompeuses aux autorités : La fourniture d’informations incorrectes ou trompeuses aux régulateurs peut déclencher des amendes pouvant atteindre 7,5 millions d’euros ou 1,5 % du chiffre d’affaires.

(Note : L’Acte inclut des plafonds proportionnels pour s’assurer que les amendes ne mettent pas immédiatement en faillite les startups et les PME).

Conclusion

L’EU AI Act représente un changement fondamental dans le génie logiciel. À mesure que nous approchons de la date d’application d’août 2026 pour les systèmes à haut risque, le rôle de l’architecte IT doit évoluer. Nous ne construisons plus simplement des algorithmes ; nous concevons des systèmes sociotechniques légalement conformes, auditables et transparents. La conformité par conception doit être intégrée dès le tout premier sprint de tout projet IA.