NIST AI Risk Management Framework : Guide pour les organisations

Découvrez comment le NIST AI RMF aide les organisations à cartographier, mesurer et gérer les risques liés à l'IA. Apprenez à implémenter ce cadre essentiel pour une IA digne de confiance.

Introduction : Le plan directeur pour une IA de confiance

Alors que les organisations s’empressent d’intégrer l’intelligence artificielle dans leurs opérations, les responsables IT font face à un défi redoutable : comment gérer les risques d’une technologie intrinsèquement probabiliste, opaque et en évolution rapide ? Si des réglementations comme l’AI Act européen fixent des limites légales strictes, elles manquent souvent des plans tactiques et opérationnels dont les équipes d’ingénierie ont besoin pour construire des systèmes réellement sécurisés.

C’est là qu’intervient le NIST AI Risk Management Framework (AI RMF). Publié par le National Institute of Standards and Technology américain, l’AI RMF est un cadre volontaire et fondamental conçu pour aider les organisations à intégrer la fiabilité dans la conception, le développement, l’utilisation et l’évaluation des produits, services et systèmes d’IA. Tout comme le célèbre NIST Cybersecurity Framework (CSF) est devenu l’étalon mondial en matière de sécurité de l’information, l’AI RMF s’impose rapidement comme le référentiel définitif pour la gouvernance de l’IA en entreprise.

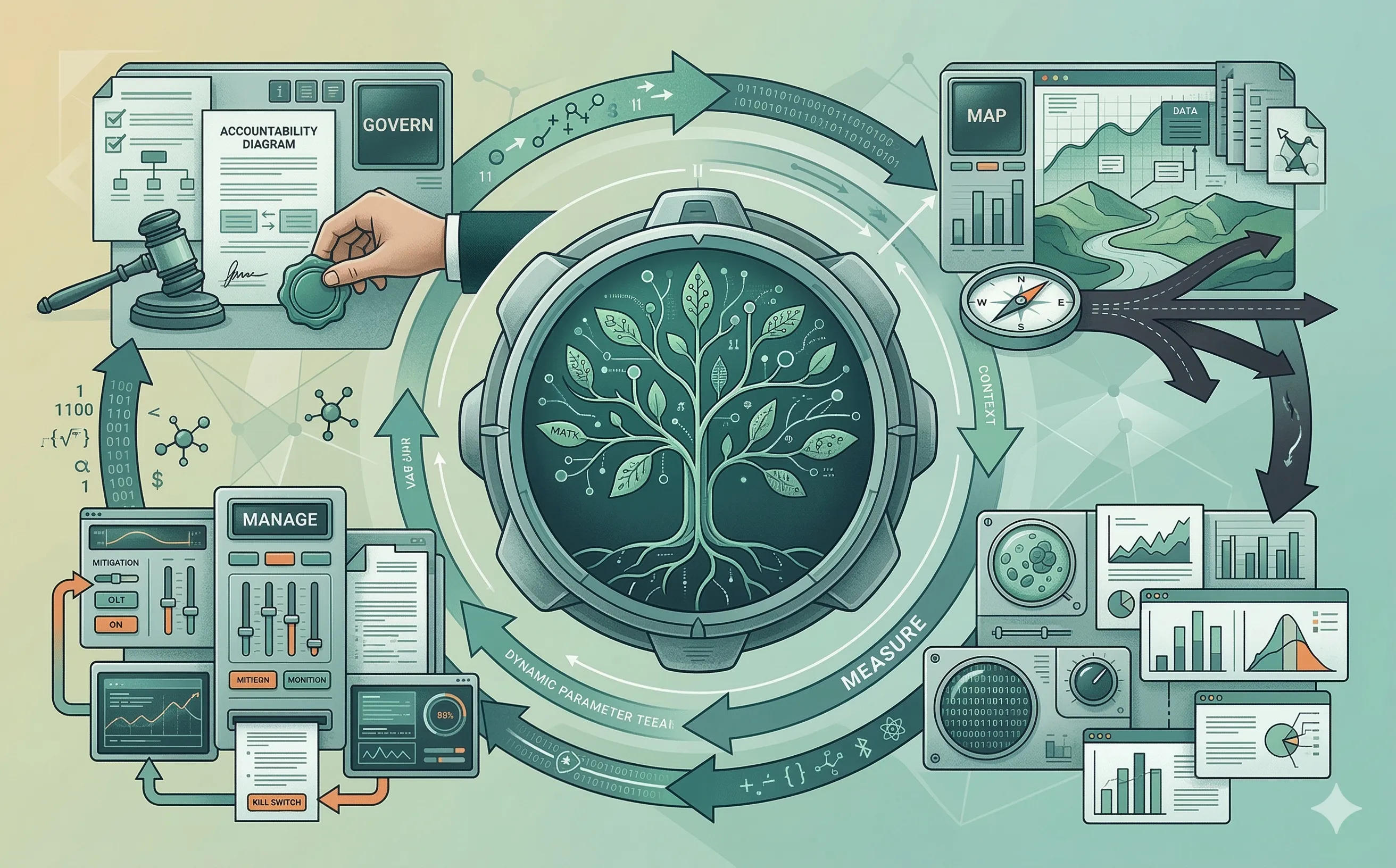

1. La structure centrale : Gouverner, Cartographier, Mesurer, Gérer

Le NIST AI RMF n’est pas une liste de contrôle statique ; c’est un cycle de vie continu et itératif conçu pour s’adapter à la nature changeante des modèles de machine learning. Le framework est divisé en quatre fonctions centrales qui doivent opérer en tandem.

Contrairement aux cycles de développement logiciel traditionnels, ces fonctions ne sont pas strictement linéaires. Parce que les modèles d’IA subissent une « dérive de concept » (leur précision et leur comportement évoluent dans le temps à mesure que les données réelles changent), les organisations doivent continuellement parcourir ces quatre piliers pour maintenir une posture fiable.

- Gouverner (Govern) : La culture, les politiques et les structures de responsabilité générales.

- Cartographier (Map) : La phase de définition du contexte où les cas d’usage, les bénéfices et les préjudices potentiels sont identifiés.

- Mesurer (Measure) : L’évaluation quantitative et qualitative de la fiabilité de l’IA.

- Gérer (Manage) : La priorisation active, la mitigation et la surveillance des risques identifiés.

2. Gouverner : le fondement de la responsabilité en matière d’IA

Dans l’AI RMF, la fonction Gouverner est au cœur du framework, car sans responsabilité exécutive et culture de la gestion des risques, les trois autres fonctions échoueront. Le risque IA ne peut pas être entièrement délégué aux équipes DevSecOps ou de data science ; il requiert un mandat transfonctionnel.

Pour mettre en œuvre la fonction Gouverner, les organisations doivent :

- Établir des responsabilités claires : Déterminer exactement qui est responsable des résultats du système d’IA. Si un outil algorithmique de sélection RH présente un biais racial, qui valide la stratégie de mitigation ?

- Définir la tolérance au risque : La direction doit articuler clairement le seuil de risque IA de l’organisation. Un chatbot marketing qui hallucine une fonctionnalité produit présente un profil de risque radicalement différent d’un outil de diagnostic médical autonome.

- Favoriser des équipes pluridisciplinaires : La fonction Gouverner exige que les professionnels du juridique, de la conformité, de l’éthique et des ressources humaines collaborent directement avec les ingénieurs en machine learning dès le début du projet.

3. Cartographier et Mesurer : contexte et métriques

On ne peut gérer que ce que l’on comprend. La fonction Cartographier oblige les organisations à documenter soigneusement le contexte du déploiement IA. Cela implique de cataloguer les sources de données, de comprendre les limites du modèle fondamental et de définir explicitement les cas d’usage prévus (et potentiellement imprévus).

Une fois le terrain cartographié, la fonction Mesurer applique des tests rigoureux et objectifs. Le NIST définit plusieurs caractéristiques d’une « IA de confiance » qui doivent être mesurées :

- Validité et fiabilité : Le modèle fait-il vraiment ce qu’il prétend faire sous pression ?

- Sécurité et sûreté : Le modèle est-il résilient face aux attaques adversariales, aux injections de prompt et à l’empoisonnement des données ? Des outils comme les plateformes de SIEM alimenté par IA peuvent aider à surveiller ces menaces en continu en production.

- Équité et biais : Y a-t-il des impacts disproportionnés sur des groupes démographiques protégés ?

- Explicabilité et transparence : La sortie du système peut-elle être comprise et interprétée par un opérateur humain ?

4. Gérer : mitigation et surveillance continue

La dernière fonction centrale est Gérer. Une fois les risques cartographiés et mesurés, l’organisation doit allouer des ressources pour les prioriser et les atténuer.

Les systèmes d’IA étant dynamiques, la fonction Gérer met fortement l’accent sur la surveillance continue.

- Réponse aux incidents pour l’IA : Les plans de réponse aux incidents IT standards échouent souvent lorsqu’ils sont appliqués à l’IA. Si un modèle commence à générer du contenu toxique ou à divulguer des données d’entraînement propriétaires, la fonction Gérer prescrit des étapes de mitigation préplanifiées, comme le retour à une version précédente des poids du modèle, l’activation de contrôles manuels avec intervention humaine, ou le déclenchement d’un « kill switch » automatisé.

- Boucles de rétroaction : Le framework exige des mécanismes pour recueillir les retours du monde réel auprès des utilisateurs finaux et des communautés impactées, garantissant que les performances du modèle en production correspondent aux lignes de base établies lors de la phase Mesurer.

Conclusion

Le NIST AI RMF comble le fossé entre les principes éthiques de haut niveau et l’ingénierie pratique sur le terrain. Pour les professionnels IT et les responsables techniques, adopter ce framework n’est plus un simple exercice théorique ; c’est un impératif stratégique. En mettant en œuvre les fonctions Gouverner, Cartographier, Mesurer et Gérer, les organisations peuvent déployer en toute confiance des solutions IA innovantes tout en démontrant aux auditeurs, aux régulateurs et aux clients qu’elles sécurisent activement l’avenir de leur chaîne d’approvisionnement logicielle. Pour des conseils pratiques sur la mise en application de ces principes, consultez l’article sur la gouvernance de l’IA défensive.