RGPD & LLM : Le « Droit à l'Oubli » dans un Réseau de Neurones

Explorez le conflit technique et juridique entre le droit à l'effacement du RGPD et l'architecture probabiliste des Large Language Models, et comment les entreprises peuvent s'adapter.

Introduction : La Mémoire Irréversible de l’IA

Dans l’Union européenne, la protection des données n’est pas seulement une bonne pratique ; c’est un droit humain fondamental inscrit dans le Règlement Général sur la Protection des Données (RGPD). L’une des dispositions les plus puissantes et les plus strictement appliquées du RGPD est l’article 17 : le « Droit à l’Effacement », communément appelé le Droit à l’Oubli.

Pour les systèmes IT traditionnels, se conformer à l’article 17 est simple, bien que parfois complexe à exécuter. Si un utilisateur demande la suppression de ses données, un administrateur de base de données exécute une commande DELETE sur les tables SQL, purge les sauvegardes, et les données disparaissent.

Cependant, l’adoption rapide des Large Language Models (LLMs) a créé une collision massive entre les mandats légaux et l’informatique. Comment supprimer les données d’une personne spécifique d’une IA qui les a déjà ingérées, apprises, et intégrées dans un réseau de neurones à un milliard de paramètres ? Pour les architectes IT et les dirigeants d’entreprise, résoudre ce paradoxe est essentiel au déploiement légal de l’IA — notamment au regard des exigences strictes de l’EU AI Act.

1. Le Conflit Architectural Fondamental

Pour comprendre le cauchemar de la conformité, nous devons comprendre comment un LLM stocke les informations. Un LLM n’est pas une base de données ; c’est un moteur probabiliste.

- Le Paradigme de la Base de Données : Les bases de données traditionnelles stockent des faits discrets en lignes et colonnes. Supprimer une ligne n’affecte pas les autres lignes.

- Le Paradigme du Réseau de Neurones : Lorsqu’un LLM est entraîné sur un jeu de données contenant des données personnelles, ce texte est décomposé en tokens. Le modèle apprend les relations statistiques entre ces tokens, ajustant des milliards de poids mathématiques à travers ses couches neurales. Les données personnelles cessent d’exister en tant que « fichier » discret et deviennent une représentation mathématique abstraite distribuée à travers l’ensemble du réseau.

Parce que les données sont distribuées de manière contextuelle, il n’existe pas de fonction « Ctrl+F » ou DELETE dans un réseau de neurones entraîné. On ne peut pas extraire chirurgicalement les données d’une personne sans modifier fondamentalement les poids mathématiques qui dictent l’intelligence et les performances globales du modèle.

2. La Solution par Force Brute, Coûteuse

Actuellement, si une entreprise entraîne un LLM propriétaire sur des données clients et qu’un client invoque son Droit à l’Oubli, la seule méthode mathématiquement garantie pour l’effacer du modèle est la méthode par force brute : Ré-entraînement depuis Zéro.

L’organisation doit :

- Supprimer les données de l’utilisateur du corpus d’entraînement original.

- Démarrer les clusters GPU.

- Ré-entraîner entièrement le modèle fondamental ou l’itération fine-tunée depuis zéro.

Pour les modèles massifs, cela coûte des millions d’euros et prend des semaines de calcul. D’un point de vue managérial et financier, ré-entraîner un modèle d’entreprise chaque fois qu’un utilisateur soumet une demande RGPD est totalement insoutenable.

3. Machine Unlearning : La Frontière Émergente

Pour combler ce fossé, les chercheurs en IA développent un nouveau sous-domaine de l’informatique appelé le Machine Unlearning. L’objectif est de développer des algorithmes capables d’indiquer à un réseau de neurones d’« oublier » des données d’entraînement spécifiques sans avoir à ré-entraîner depuis zéro.

- Unlearning Approximatif : Des techniques sont développées pour identifier quels poids spécifiques ont été le plus fortement influencés par le point de donnée ciblé et « inverser » ou pénaliser mathématiquement ces poids.

- Le Risque d’Oubli Catastrophique : Le défi principal du machine unlearning est que modifier agressivement les poids pour faire oublier un fait au modèle provoque souvent un effet en cascade, entraînant l’oubli spontané d’informations cruciales et sans rapport, ou dégradant ses capacités linguistiques globales.

Bien que prometteur, le vrai Machine Unlearning est encore largement expérimental et n’a pas encore atteint la maturité requise pour une conformité légale garantie à l’échelle de l’entreprise.

4. Architectures Pragmatiques pour la Conformité en Entreprise

Parce que la technologie sous-jacente de l’« unlearning » n’est pas encore mature, les architectes IT doivent s’appuyer sur des solutions de contournement au niveau système pour maintenir la conformité RGPD tout en exploitant l’IA.

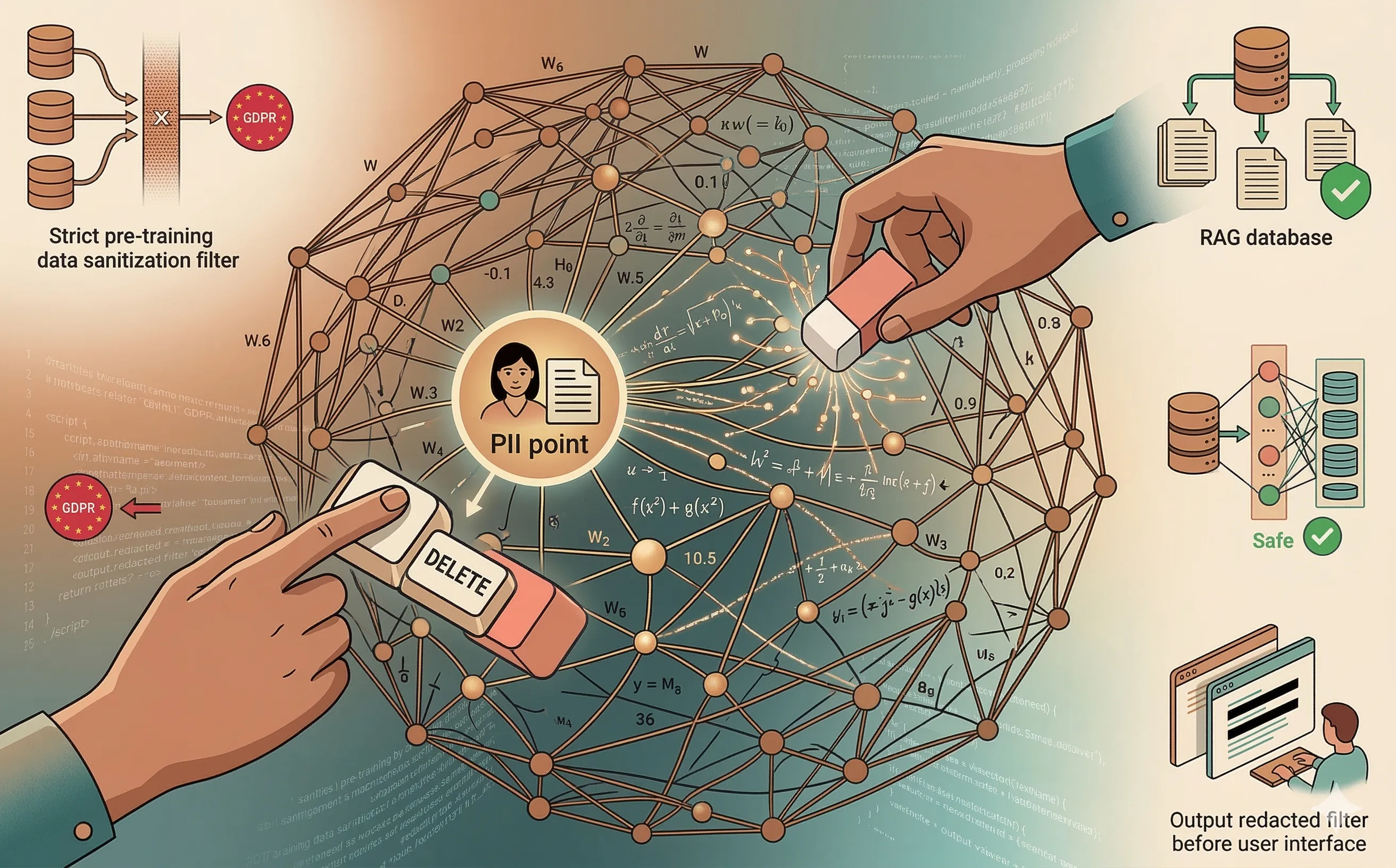

- Assainissement Strict des Données Avant l’Entraînement : La défense la plus efficace consiste à agir en amont. Les équipes d’entreprise doivent utiliser des pipelines agressifs de Data Loss Prevention (DLP) et de rédaction des PII pour purger toutes les données personnelles du corpus avant que le modèle ne les voie lors de la phase d’entraînement ou de fine-tuning. Cela contribue également à atténuer les risques d’empoisonnement de données en imposant un contrôle strict sur ce qui entre dans le pipeline d’entraînement.

- Retrieval-Augmented Generation (RAG) : Au lieu de fine-tuner le modèle sur des données clients sensibles, les organisations adoptent des architectures RAG. Dans un système RAG, le LLM lui-même ne contient aucune donnée personnelle. Lorsqu’un utilisateur pose une question, le système interroge une base de données traditionnelle et sécurisée pour les faits pertinents, les insère temporairement dans la fenêtre de prompt du LLM et génère une réponse. Si un utilisateur demande la suppression, l’IT efface simplement son enregistrement de la base de données traditionnelle. Le LLM perd immédiatement accès à ces données, satisfaisant parfaitement l’article 17.

- Garde-fous d’Entrée et de Sortie : Des firewalls IA spécialisés sont déployés pour surveiller activement les sorties du modèle. Même si le modèle parvenait à mémoriser un élément de PII lors de l’entraînement, le filtre de sortie agit comme un dispositif de sécurité, interceptant et rédigeant les données personnelles avant qu’elles ne soient affichées à un utilisateur final.

Conclusion

Le conflit entre le RGPD et l’IA générative met en lumière un thème récurrent dans l’IT moderne : la loi attend une conformité déterministe de systèmes de plus en plus probabilistes. Jusqu’à ce que la science du Machine Unlearning arrive à maturité, les organisations doivent concevoir leurs déploiements d’IA de manière défensive. Les questions de souveraineté des données deviennent également primordiales lorsqu’il s’agit de décider où et comment les données personnelles sont traitées. En utilisant massivement les architectures RAG et un assainissement strict avant l’entraînement, les responsables IT peuvent exploiter la puissance des LLMs sans franchir la formidable frontière du Droit à l’Oubli.