Sécurité & Green IT : Le Coût Énergétique de l'Entraînement des Modèles Défensifs

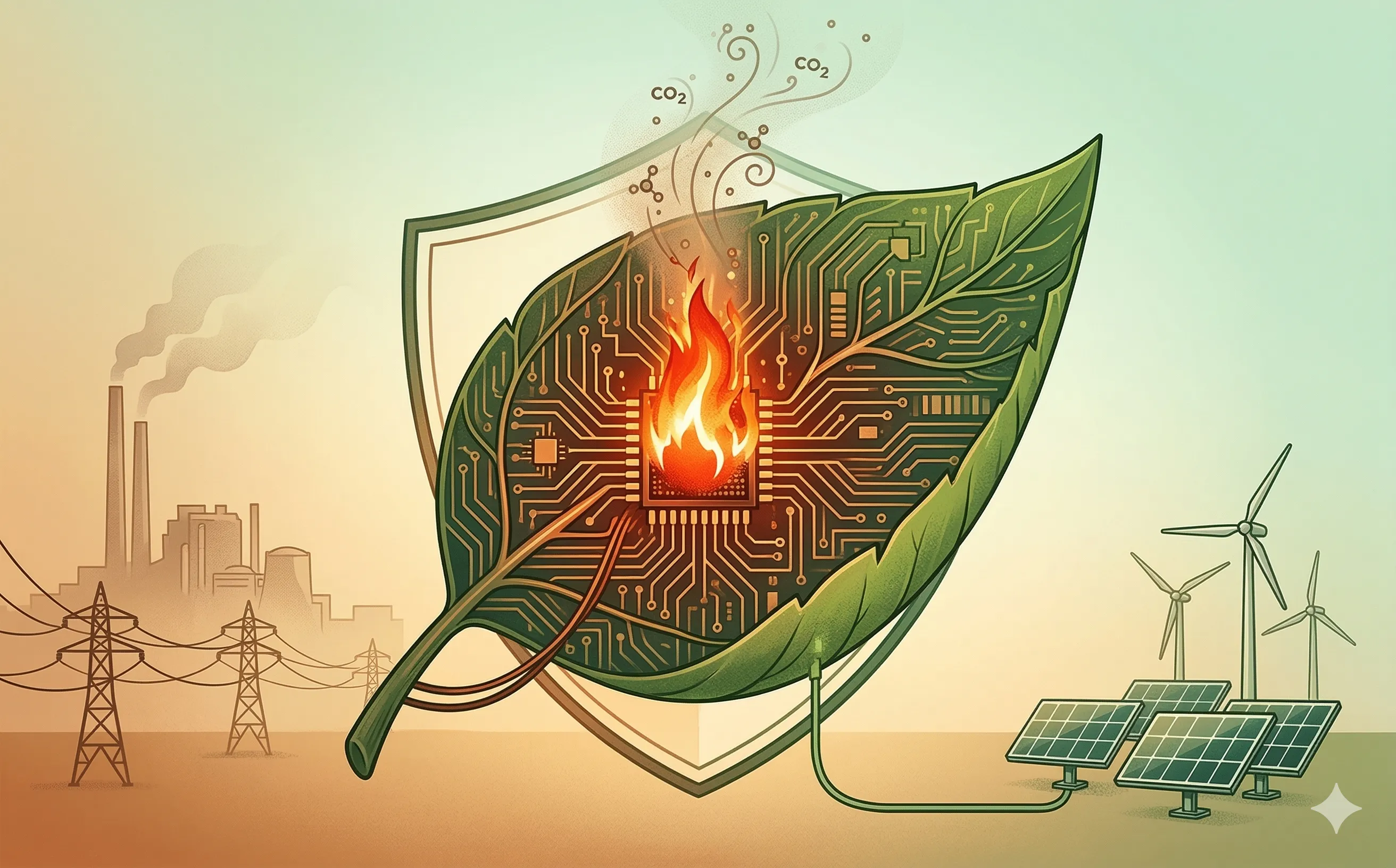

Analysez l'intersection du Green IT et de la cybersécurité. Comprenez l'empreinte carbone massive des outils de sécurité pilotés par l'IA et comment construire une architecture DevSecOps durable.

Introduction : Le Coût Caché de la Défense par l’IA

Au cours de l’année écoulée, nous avons établi que l’Intelligence Artificielle est indispensable pour défendre l’entreprise moderne. Du red teaming autonome à la gestion de la posture de sécurité cloud pilotée par ML, l’IA est le seul outil capable de rivaliser avec la vitesse et l’échelle des cybermenaces actuelles. Cependant, cette suprématie défensive s’accompagne d’un coût externe massif et souvent négligé : la Consommation Énergétique.

Pour les directeurs IT et les Chief Information Security Officers (CISOs), la cybersécurité ne peut plus être envisagée indépendamment des objectifs de Responsabilité Sociale des Entreprises (RSE) et d’Environnement, Social et Gouvernance (ESG) de l’organisation. L’entraînement et l’exploitation de modèles de machine learning avancés nécessitent de vastes data centers, des GPUs spécialisés et des quantités considérables d’électricité. Alors que l’IT d’entreprise se tourne vers des initiatives « Green IT », les responsables de la sécurité font face à un paradoxe : comment protéger votre infrastructure contre des cyberattaques dévastatrices sans détruire les objectifs de réduction carbone de votre organisation ?

1. L’Empreinte Carbone de l’IA Défensive

Pour comprendre l’ampleur du problème, nous devons distinguer les deux phases du cycle de vie d’un modèle de machine learning : l’Entraînement et l’Inférence.

- Le Fardeau de l’Entraînement : L’entraînement d’un Large Language Model (LLM) fondamental ou d’un réseau de neurones de détection comportementale complexe nécessite des milliers de GPUs fonctionnant à pleine capacité pendant des semaines ou des mois. Ce processus consomme des gigawattheures d’électricité et génère des centaines de tonnes équivalents CO2.

- La Taxe d’Inférence Sécurité : Bien que l’entraînement soit très énergivore, il s’agit d’un événement peu fréquent. Pour la cybersécurité, le vrai gouffre énergétique est l’inférence — l’acte d’interroger le modèle en temps réel. Si une entreprise déploie un Web Application Firewall (WAF) piloté par l’IA, le modèle doit traiter, analyser et noter chaque requête HTTP et paquet réseau entrant dans l’organisation 24h/24 et 7j/7. L’extension de cette capacité à une architecture cloud mondiale génère une consommation énergétique de base continue et massive.

2. Le Concept Drift et le Cycle de Ré-entraînement Continu

Contrairement à une application logicielle standard qui peut être compilée une fois et fonctionner pendant des années, les modèles d’IA défensifs se dégradent avec le temps. Ce phénomène est connu sous le nom de Concept Drift.

Les adversaires font continuellement évoluer leurs tactiques, techniques et procédures (TTPs). Ils développent de nouvelles signatures de malware, de nouvelles techniques d’injection de prompts et des schémas comportementaux variés. Un modèle de machine learning entraîné pour détecter le paysage des menaces de janvier sera dangereusement inexact en juin.

Pour maintenir son efficacité, le SOC (Security Operations Center) doit mettre en œuvre un pipeline de ré-entraînement continu. L’équipe DevSecOps doit constamment alimenter le modèle avec de nouveaux renseignements sur les menaces et ré-entraîner ses poids neuraux. Cela signifie que le coût énergétique massif de l’entraînement n’est pas une dépense en capital ponctuelle ; c’est une taxe énergétique opérationnelle continue qui augmente de façon permanente l’empreinte carbone du département IT.

3. Architecture Durable : Les Small Language Models (SLMs)

Réconcilier une cybersécurité robuste avec le Green IT nécessite un changement architectural fondamental. L’ère où l’on déployait des LLMs massifs à des milliards de paramètres pour chaque problème de sécurité mineur touche à sa fin. Les architectes IT passent à des déploiements hautement optimisés et durables.

- Dimensionner l’IA à sa Juste Taille : Vous n’avez pas besoin de GPT-4 pour déterminer si un paquet réseau est malformé. Au lieu de s’appuyer sur des modèles généralistes massifs, les équipes de sécurité déploient des Small Language Models (SLMs) et des algorithmes d’IA étroite et spécialisée (comme les Random Forests ou le Gradient Boosting). Ces modèles sont une fraction de la taille, nécessitent exponentiellement moins de puissance de calcul pour l’entraînement, et exécutent l’inférence en quelques millisecondes avec une consommation énergétique minimale.

- Edge Computing : Comme nous l’avons vu dans notre analyse de la sécurité IoT, déplacer l’inférence IA des grands data centers cloud centralisés directement vers la périphérie (le dispositif endpoint ou le routeur local) réduit considérablement l’énergie consommée par la transmission continue de données. Cela répartit la charge thermique et électrique sur l’ensemble du réseau, permettant une architecture plus durable.

4. Le Mandat Réglementaire ESG (CSRD)

Pour les responsables IT opérant dans l’Union européenne, équilibrer sécurité et durabilité n’est plus une simple préférence morale ; c’est une obligation légale stricte.

La Corporate Sustainability Reporting Directive (CSRD) oblige les grandes entreprises à divulguer de manière exhaustive leur impact environnemental, en incluant explicitement leur empreinte carbone numérique (émissions Scope 3).

- La Sécurité comme Émettrice : Lorsqu’une organisation provisionne des services de sécurité cloud très intensifs, l’énergie consommée par le fournisseur cloud (AWS, Azure, GCP) compte dans le propre reporting carbone de l’organisation.

- L’Évolution des Achats : Les CISOs doivent désormais évaluer les éditeurs de cybersécurité non seulement sur leurs taux de détection, mais aussi sur leur efficacité énergétique. Les appels d’offres de sécurité exigent de plus en plus que les éditeurs fournissent des données télémétriques sur l’efficacité computationnelle de leurs modèles d’IA et la preuve que leurs data centers fonctionnent aux énergies renouvelables.

Conclusion

L’avenir de la gestion IT d’entreprise exige d’équilibrer des menaces existentielles. Une attaque ransomware catastrophique peut mettre en faillite une entreprise, mais ignorer les besoins énergétiques du stack de sécurité conduira inévitablement à des amendes réglementaires et à des échecs ESG publics. En adoptant les principes du Green IT — dimensionner les modèles à leur juste taille, pousser l’inférence vers la périphérie et exiger l’efficacité computationnelle des éditeurs — les responsables IT peuvent construire une architecture défensive qui protège à la fois les données de l’organisation et ses engagements environnementaux.