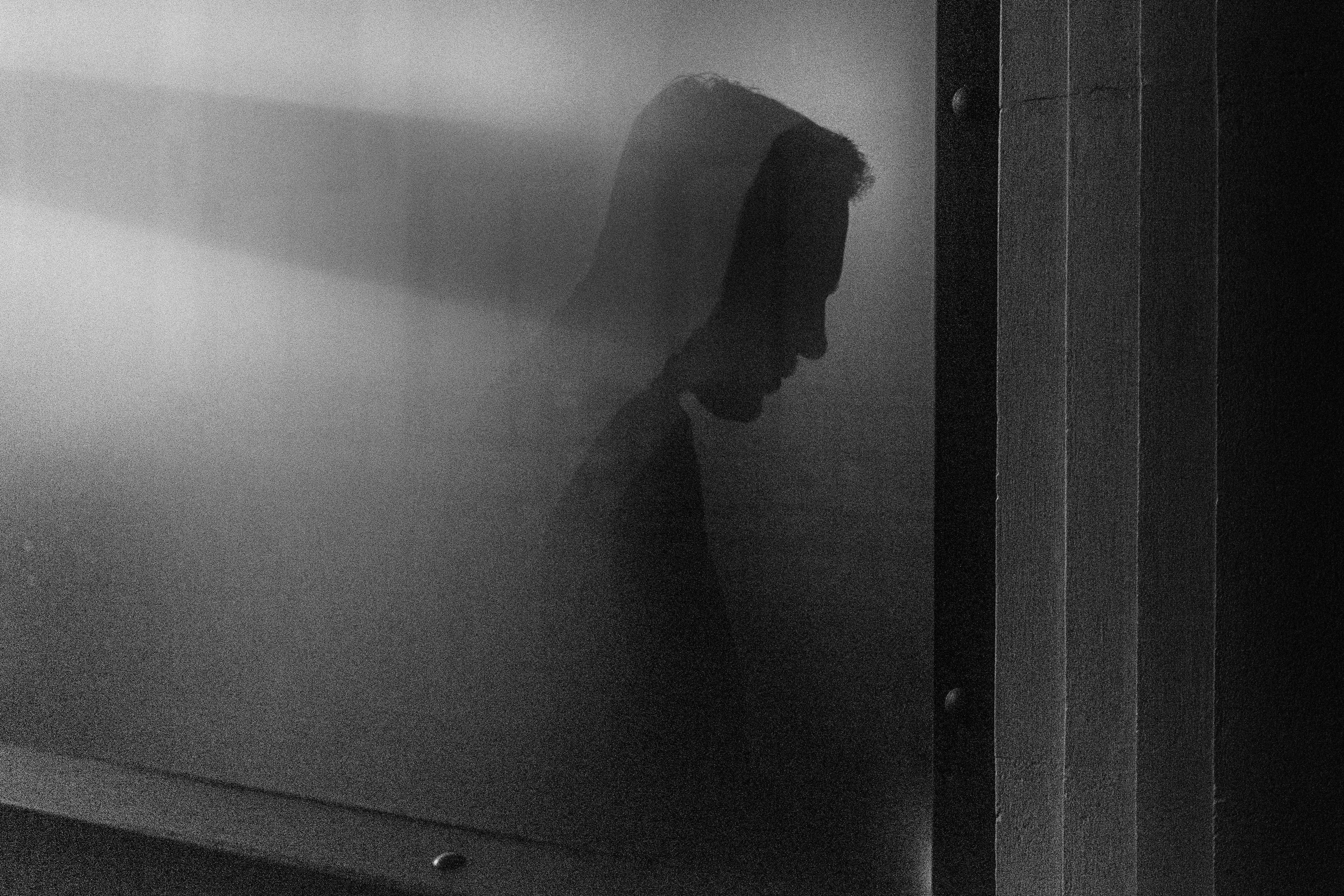

Shadow AI : la menace silencieuse pour votre supply chain logicielle

Réduisez les risques du Shadow AI. Analysez comment les LLMs non autorisés provoquent l'exfiltration de données et introduisent des vulnérabilités critiques dans votre supply chain logicielle.

Introduction : L’épée à double tranchant de la productivité

L’intégration rapide des Large Language Models (LLMs) dans le cycle de vie du développement logiciel représente le changement le plus significatif dans les pratiques de codage depuis l’avènement de Stack Overflow. Des outils comme GitHub Copilot, ChatGPT et Claude ont considérablement réduit le temps passé sur le boilerplate et accéléré le time-to-market. Cependant, cette efficacité a un coût caché : la montée du « Shadow AI ». Similaire au phénomène du Shadow IT de la décennie précédente, le Shadow AI désigne l’utilisation non autorisée d’outils d’IA générative par les employés sans supervision du département IT. Pour les organisations de développement logiciel et d’IT, cette pratique introduit deux vecteurs de risque critiques : l’exfiltration de propriété intellectuelle et l’introduction de vulnérabilités dans la base de code.

1. L’exfiltration de données et la boucle d’entraînement

Le danger immédiat du Shadow AI réside dans les mécanismes de traitement des données des LLMs publics. Lorsqu’un développeur colle un bloc de code dans un chatbot public pour demander une correction de bug, une optimisation ou de la documentation, il transmet effectivement ces données à un serveur externe. Contrairement aux environnements entreprise, les offres gratuites ou standard de ces services se réservent souvent le droit d’utiliser les données saisies pour le réentraînement du modèle.

Cela crée un scénario où des informations sensibles — telles que des algorithmes propriétaires, des schémas de bases de données, des clés d’API ou des identifiants hardcodés — quittent le périmètre sécurisé de l’entreprise. Une fois ces données ingérées par le modèle, elles font partie de la matrice probabiliste du réseau de neurones. En théorie, ces informations propriétaires pourraient être régurgitées en réponse à un prompt d’un concurrent ou d’un acteur malveillant. Pour les organisations soumises à des réglementations strictes comme le RGPD en Europe, cela constitue une violation grave de conformité. Les mécanismes d’opt-out fournis par les fournisseurs d’IA publics sont souvent obscurs ou ignorés par les utilisateurs finaux, faisant de la fuite inadvertante de secrets commerciaux une inévitabilité statistique plutôt qu’une simple possibilité.

2. L’illusion de la sécurité : les vulnérabilités générées par l’IA

Le deuxième risque majeur concerne la sortie générée par ces modèles. Il est crucial que les professionnels IT comprennent que les LLMs ne sont pas des moteurs logiques ; ce sont des prédicteurs probabilistes de tokens. Ils privilégient la plausibilité et la syntaxe plutôt que la sécurité et la correction. Par conséquent, les outils IA suggèrent fréquemment du code fonctionnel mais non sécurisé.

Des recherches ont montré que les assistants de code IA perpétuent souvent des vulnérabilités legacy. Si un modèle a été entraîné sur des dépôts open source contenant des failles d’injection SQL ou de Cross-Site Scripting (XSS), il est susceptible de reproduire ces motifs lorsqu’il en est invité. De plus, un nouveau vecteur de menace connu sous le nom d’« hallucination de packages IA » a émergé. Dans ce scénario, une IA suggère d’importer une bibliothèque logicielle qui n’existe pas mais qui porte un nom plausible. Les attaquants peuvent anticiper ces hallucinations, enregistrer le nom du package inexistant sur des dépôts comme npm ou PyPI, et y injecter du code malveillant. Lorsqu’un développeur accepte aveuglément la suggestion de l’IA et exécute la commande d’installation, il compromet toute sa supply chain.

3. L’érosion de la revue de code et la dépendance des juniors

Au-delà des failles techniques immédiates, le recours au Shadow AI favorise une dégradation à long terme de l’expertise des développeurs. La culture du « copier-coller », auparavant limitée aux forums, est désormais automatisée. Les développeurs juniors peuvent implémenter une logique complexe générée par l’IA sans en comprendre pleinement les mécanismes sous-jacents ni les cas limites.

Ce manque de compréhension rend le code plus difficile à maintenir et à déboguer. Lorsqu’un système tombe en panne, le développeur qui a implémenté la solution générée par l’IA peut manquer des connaissances théoriques pour la corriger. Cette accumulation de « dette technique » rend l’architecture logicielle fragile. De plus, parce que le code est syntaxiquement parfait et inclut des commentaires, il passe souvent outre le contrôle rigoureux des relecteurs humains qui supposent que la machine « sait mieux ». Cette complaisance crée un faux sentiment de sécurité, permettant à de subtiles erreurs de logique et des backdoors de persister dans les environnements de production jusqu’à ce qu’ils soient exploités.

4. Atténuation stratégique : de l’interdiction à la gouvernance

Tenter de bloquer tout accès à l’IA est une stratégie futile qui encourage le contournement. Au lieu de cela, les départements IT doivent passer de la prohibition à la gouvernance. La solution réside dans la mise à disposition d’alternatives sanctionnées et de niveau entreprise où la confidentialité des données est garantie contractuellement.

Les organisations doivent mettre en place des « instances privées » ou des licences entreprise (comme Azure OpenAI ou Copilot for Business) dont les conditions de service stipulent explicitement que les données saisies ne sont pas utilisées pour l’entraînement du modèle et sont supprimées après la session. Côté développement, l’intégration d’outils de Static Application Security Testing (SAST) doit être obligatoire pour scanner le code généré par l’IA avant qu’il ne soit commité dans le dépôt. En définitive, le rôle du développeur évolue de « rédacteur de code » vers « auditeur de code ». L’expert humain reste le dernier gardien, et la politique organisationnelle doit refléter que l’IA est un copilote, pas le capitaine du navire.