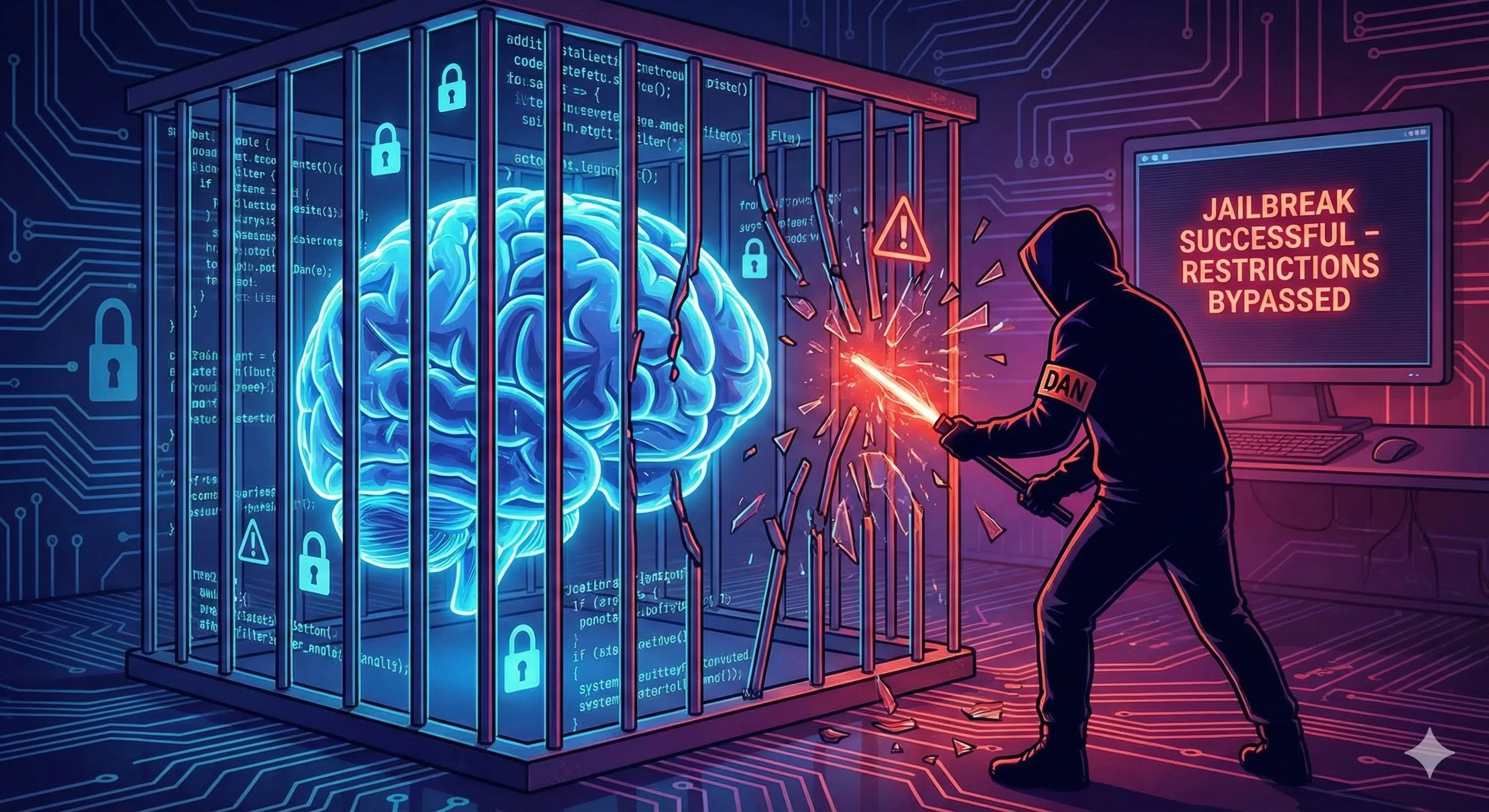

Jailbreaking des LLM : Le phénomène "DAN" (Do Anything Now)

Comment les utilisateurs contournent les filtres de sécurité de l'IA avec les jailbreaks "DAN". Explorez l'évolution du roleplay aux attaques automatisées et les limites de l'alignement RLHF.

18 avr. 20253 min de lecture